分類:AI人工智慧學習

在 AI 學習紀錄 – 利用 Docker 部屬模型這篇文章裡,開始試用 Nvidia Docker 來部屬不同的模型,來確保未來的可用性。裝第一個 chatGLM2的時候還蠻順利的,後面

我本來學習 AI 是抱著把流程寫詳細,下次要用就從頭來的把每個步驟跑一遍的想法。這也是我過去工作上的習慣,要搭建一個服務就會寫的詳細一點,下次從頭來省事。但最近學習 AI, 發現很多模組都進版的很快,

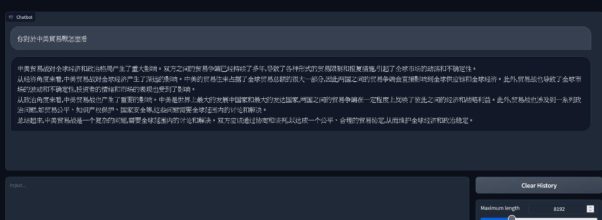

在上一篇 AI 學習紀錄 – ChatGLM2-6B 使用與微調 裡,我們單獨的介紹 ChatGLM2 這個類 chatGPT 專案。而本文要介紹的是基於 ChatGLM2 (或其它聊天系

有好一陣子沒研究 AI 了 (RTX 4090 哭哭),最主要的原因是搞不出來個什麼毛。自己訓練的 GPT2 效果一直很差,最受益的可能還是學到它的一點點精神吧。 昨天突然又想到來研究一下有沒有新東西

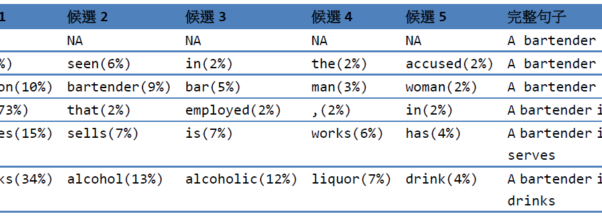

在上一篇AI 學習紀錄 – 單步GPT推論 (2)實現在單步推論後,要回頭過來講訓練的過程。之前的文章沒細看其訓練的過程,所以在這就先從字典產生來看。 基本環境安裝 一些基本的環境 (如 anacon

接著上一篇的AI 學習紀錄 – 單步GPT推論, 網頁架設 (1),接下來就是做單步推論了。單步推論所需要安裝的東西,差不多跟完整的訓練差不多。所以還是 follow 之前的 AI 學習文章,儘量提供

最近生成式 AI 好像有點退燒,所以也少了一點研究,當然自己工作最近也忙了起來,比較沒時間。但最近隨著 Nvidia 股價噴出,多少還是要研究一點,不然貴森森的 RTX4090 就白花了。 之前研究的

本篇簡單使用一個語句相似型的模型,做為往後可利用的工具。這可以利用在檢查是否是同類文章或抄襲之類的,效果普普,不過也算是加減用,有需要再找更強大的。 基本環境安裝 一些基本的環境 (如 anacond

本篇簡單使用一個中英文翻譯的模型,做為往後可利用的工具。這樣大量翻譯,就不用再使用Google翻譯了! 基本環境安裝 一些基本的環境 (如 anaconda、共用 script) 的設定,已經寫在【共

本篇要介紹的是另一個語音識別專案 PPASR,一個基於飛槳的專案。由於之前試用的 ASRT 中文語音識別 效果不太好,用 sample 檔辨識不錯,但由我自己錄的聲音卻是一團糟。 今天介紹的這個 P